Каждый из нас видел видео или слышал аудиозапись, которые вызывали сомнения: «А действительно ли этот человек так сказал?». В прошлом такие мысли возникали редко, ведь видео считалось неопровержимым доказательством. Сегодня же с появлением дипфейков (deepfake) это доверие пошатнулось.

Дипфейк — это не просто очередной технологический тренд. Это инструмент, который может быть использован как во благо (в кино, образовании, медицине), так и во вред (в мошенничестве, политической пропаганде или киберпреступности).

Благодаря развитию искусственного интеллекта любой может создать реалистичный дипфейк, не имея профессиональных знаний. И это делает проблему еще более опасной.

Что такое дипфейк

Дипфейк (от англ. deep learning — «глубинное обучение» и fake — «подделка») — это технология создания поддельных изображений, видео или аудио с помощью алгоритмов машинного обучения и нейронных сетей. Простыми словами, дипфейк — это фальшивый контент, который выглядит максимально реалистично.

Дипфейк-фишинг — это новый вид киберпреступления, при котором мошенники используют технологии дипфейков (искусственно сгенерированное видео или аудио) для выманивания денег, конфиденциальной информации или доступа к системам. То есть, это сочетание классического фишинга (мошеннических писем, звонков, сообщений) с возможностями AI-манипуляций.

Ключевые особенности дипфейков

- замена лица в видео;

- имитация голоса и интонации человека;

- воспроизведение мимики, эмоций и движений;

- возможность «оживить» фото или даже создать вымышленного персонажа.

История возникновения дипфейков

Впервые слово deepfake появилось в 2017 году на платформе Reddit. Пользователь под ником deepfakesпубликовал ролики, где с помощью алгоритмов подменял лица известных людей.

Первые волны популярности

- 2017–2018 гг. — волна скандалов из-за фейковых видео с голливудскими актерами.

- 2019 год — первые сообщения об использовании дипфейков в мошеннических схемах.

- 2020–2023 гг. — активное применение дипфейков в политике, пропаганде и медиа.

Как работают дипфейки

Создание дипфейка — это сложный процесс, но принцип его понять легко.

1. Сбор данных

Алгоритм требует большого количества фото и видео с человеком (с разных ракурсов и при разном освещении).

2. Обучение нейросети

Используется метод глубокого обучения: система «изучает» черты лица, движения и голос.

3. Генерация дипфейка

Применяются генеративно-соревновательные сети (GANs):

- Generator создает подделку,

- Discriminator оценивает ее качество и пытается найти ошибки.

Чем дольше тренируется модель, тем реалистичнее становится дипфейк.

4. Инструменты для создания дипфейков

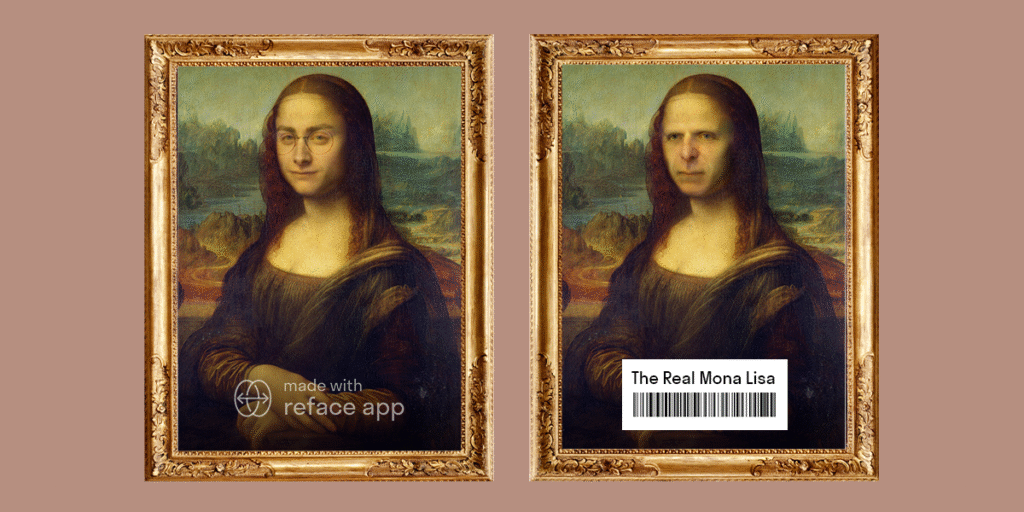

Сегодня существуют как профессиональные программы, так и простые мобильные приложения.

- DeepFaceLab — популярен среди энтузиастов.

- Zao — китайское приложение для быстрых видеоподмен.

- Reface — украинский стартап, который стал вирусным в мире.

Примеры дипфейков в мире

1. Политика

- В 2019 году распространялось фейковое видео со спикером Конгресса США Нэнси Пелоси, где ее голос сделали «замедленным», чтобы создать впечатление опьянения.

- В 2022 году в соцсетях появился дипфейк президента Украины Владимира Зеленского с призывом сложить оружие.

2. Киберпреступления

- Известный случай в Великобритании: мошенники использовали дипфейковый голос директора компании, чтобы обмануть менеджера и получить перевод на 243 000 евро.

3. Развлечения

- В TikTok активно распространяются ролики с дипфейковыми лицами звезд.

- В Голливуде технологию используют для омоложения актеров (например, в фильмах Marvel).

4. Скандальные истории

- Наиболее обсуждаемые случаи — дипфейк-порно с известными актерами. Это серьезно вредит их репутации.

Опасность дипфейков

Дипфейки — это больше, чем просто «цифровые шутки».

- Могут влиять на выборы и общественное мнение.

- Используются для пропаганды и создания недоверия к официальным лицам.

- Поддельное видео может навсегда разрушить карьеру.

- Пострадавший человек вынужден доказывать, что этого не было.

- Жертвы дипфейков часто сталкиваются с депрессией, стрессом и кибербуллингом.

- Потеря доверия в обществе: «А можно ли верить тому, что мы видим?».

- Использование дипфейков для подделки голосов в бизнесе уже стало реальностью.

- Возможность мошеннических звонков от «родственников» с просьбой о деньгах.

Как распознать дипфейк

Дипфейки становятся все более реалистичными, однако даже самые современные подделки имеют слабые места. Выявить их можно, если внимательно присмотреться к деталям и использовать вспомогательные инструменты.

Визуальные признаки

- Мимика лица. Часто губы двигаются не синхронно со словами.

- Глаза. Алгоритмы плохо воспроизводят моргание: оно может быть слишком редким или странным.

- Освещение. Тени и оттенки кожи не совпадают с окружением.

- Движения головы. В фейковых видео они выглядят неестественными, «застывшими».

Аудиопризнаки

- Голос звучит монотонно и неестественно.

- Есть металлические призвуки или «роботизированное» звучание.

- Смех и эмоции воспроизводятся хуже всего — они часто выглядят искусственно.

Технические инструменты

- Microsoft Video Authenticator — определяет манипуляции в изображении.

- Deepware Scanner — мобильное приложение для проверки видео.

- InVID — плагин для браузера, анализирующий видео из соцсетей.

Критическое мышление

- Всегда проверяйте видео в нескольких источниках.

- Используйте обратный поиск изображений в Google или TinEye.

- Если контент кажется слишком сенсационным — это может быть подделка.

Методы борьбы с дипфейками

Технология дипфейков развивается чрезвычайно быстро, и одновременно растет опасность их использования для обмана, манипуляций и мошенничества. Поэтому мировое сообщество ищет эффективные способы защиты. Методы борьбы с дипфейками можно условно разделить на технологические, правовые и образовательные.

Алгоритмы обнаружения

Технологические гиганты (Google, Meta, Microsoft) создают искусственный интеллект, который распознает подделки.

Законодательное регулирование

- В США несколько штатов приняли законы против дипфейков на выборах.

- В Китае введены правила, требующие маркировать AI-контент.

- Европейский Союз работает над AI Act, который регулирует использование искусственного интеллекта.

Медиаграмотность населения

- Лучшая защита — знания и критическое мышление.

- Люди должны научиться проверять источники и сомневаться во всем подозрительном.

Часто задаваемые вопросы (FAQ)

1. Что такое дипфейк простыми словами?

Это поддельное видео или аудио, созданное с помощью искусственного интеллекта.

2. Опасны ли дипфейки?

Да. Они могут наносить вред политике, бизнесу и личной жизни людей.

3. Как отличить дипфейк от реального видео?

Обращайте внимание на мимику, освещение, детали, используйте программы для проверки.

4. Наказывается ли создание дипфейков?

В некоторых странах — да. Особенно, если подделка используется с целью нанесения вреда.

5. Могут ли дипфейки быть полезными?

Да. В кино, образовании и медицине они имеют большой потенциал.

6. Может ли обычный человек стать жертвой?

Да. Технологии становятся доступными, и любой может оказаться в фейковом видео.

Дипфейки — это яркий пример того, как технологии могут стать одновременно полезными и опасными. С одной стороны, они открывают новые возможности для творчества, науки и развлечений. С другой — создают угрозы для безопасности, репутации и доверия к информации.

Лучший способ защититься — это медиаграмотность, критическое мышление и использование проверенных источников.

Также читайте о том, как удалить историю поиска на телефоне и компьютере?